ChatGPT & Co. und Schule

Allgemeines

Was tun?

Weiteres

Vertiefendes

Weiterführendes

Unser Material

Unsere Kurse

Webtechnisches

Funktionsweise generativer Machine-Leraning-Systeme

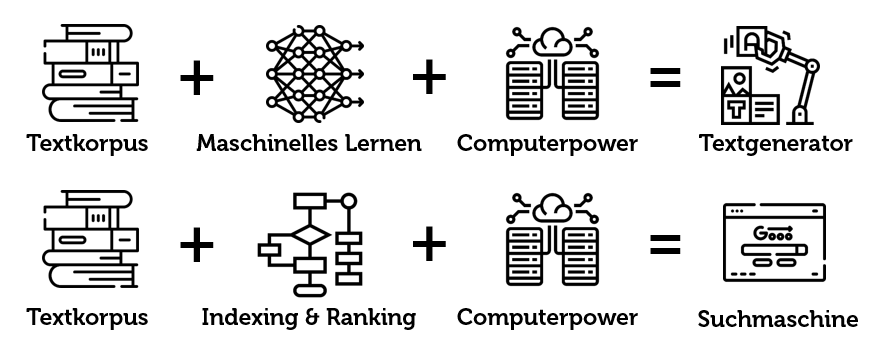

Zur Diskussion der Potenziale und Grenzen generativer Maschine-Learning-Systeme ist es nicht zwingend notwendig, deren Funktionsweise im Detail zu kennen und zu verstehen. Es genügt zu wissen, dass generative Machine-Learning-Systeme auf statistischen Verfahren beruhen, die Muster in riesigen Datenmengen finden. Diese Daten sind dabei nicht auf Textdokumente beschränkt, sondern können alles umfassen, was sich digital speichern lässt (Bilder, Tondokumente, Filme, Proteinsequenzen, Geländemodelle etc.) Aufgrund der gefundenen Wahrscheinlichkeitsverteilungen (Modelle genannt) sind GMLS danach in der Lage, statistisch erwartbare Entsprechungen zu gemachten Eingaben (sogenannten Prompts) zu generieren. So können solche Systeme nicht nur den statistisch zu erwartenden Buchstaben oder das nächste Wort voraussagen, die statistischen Daten im Modell reichen auch, um ganze Sätze und Absätze als erwartbare Fortsetzungen einer Eingabe zu generieren.Da Systeme wie ChatGPT vereinfacht formuliert mit allen auf dem Internet verfügbaren Dokumenten trainiert worden sind, verfügen sie über ein beeindruckendes Weltwissen und scheinen auch eigene Überlegungen anstellen zu können. Sogenannte Halluzinationen, das heisst erfundene Aussagen, Quellen oder Zusammenhänge zeigen aber deutlich, dass die Systeme Korrelationen und nicht Kausalitäten errechnen - was dazu geführt hat, dass GMLS oft auch als stochastische Papageien bezeichnet werden (nach Bender et al. 2021).

Von ihrem Aufbau her haben generative Machine-Learning-Systeme eine gewisse Verwandtschaft mit grossen Suchmaschinen (siehe Abbildung oben). Beide verarbeiten einen grossen Datenkorpus in einem aufwändigen und energieintensiven Trainingsverfahren, damit sie danach rasch auf einzelne Anfragen reagieren können. Um ein Gefühl für die Funktionsweise von GMLS zu bekommen, ist es empfehlenswert, solche Systeme aktiv auszuprobieren. Dadurch erhält man ein Gefühl dafür, was solche Systeme bereits können und wo ihre Grenzen liegen.

Wer sich stärker für die Funktionsweise von generativen Machine-Learning-Systemen interessiert, findet im folgenden drei Hinweise zur möglichen Vertiefung.

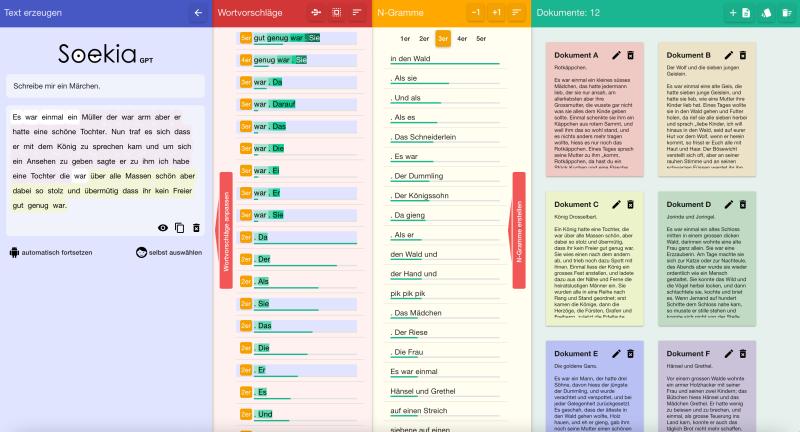

a) SoekiaGPT, das didaktische Sprachmodell

Die neue Lernumgebung SoekiaGPT von Michael Hielscher ermöglicht es Schülerinnen und Schülern ab der Sekundarstufe I unter die Motorhaube eines Textgenerators zu schauen und so wesentliche Konzepte, Potenziale aber auch Begrenzungen verstehen und den Vergleich mit einer Suchmaschine (Soekia) machen zu können. Kostenfrei, webbasiert unter www.soekia.ch nutzbar, z.B. in Fächern wie Deutsch oder Informatik. Inkl. Handreichung für Lehrpersonen.

b) Marcel Waldvogel: Wie funktioniert eigentlich ChatGPT?

Marcel Waldvogel hat einen anspruchsvollen, aber verständlichen Text zur Frage Wie funktioniert eigentlich ChatGPT? geschrieben:

c) Andrej Karpathy: Let's build GPT. From scratch, in code, spelled out.

Der Text von Marcel Waldvogel beruht teilweise auf dem Video von Andrej Karpathy, das ein gewisses Informatikwissen voraussetzt:

Die Website gmls.phsz.ch ist eine seit Dezember 2022 laufend erweiterte Sammlung von Einordnungen der Professur "Digitalisierung und Bildung" der Pädagogischen Hochschule Schwyz zur Frage, welche Auswirkungen generative Machine-Learning-Systeme wie ChatGPT auf die Schule haben.

Lizenz: Die Website steht unter einer CC-BY-ND-Lizenz, Bilder und Texte dürfen somit unter Quellenangabe an anderen Orten verwendet werden.

Zitationsvorschlag: Döbeli Honegger, Beat (2022-2026). ChatGPT & Co. und Schule. Einschätzungen der Professur "Digitalisierung und Bildung" der Pädagogischen Hochschule Schwyz. https://gmls.phsz.ch/ (abgerufen am 14 Apr 2026)

Alternativer Zitationsvorschlag: Insgesamt besteht gmls.phsz.ch aus ca. 50 einzelnen Seiten. Wesentliche Inhalte dieser Website sind auch in der folgenden, frei verfügbaren Publikation zu finden: Döbeli Honegger, Beat (2025). Generative Machine-Learning-Systeme - Die nächste Herausforderung des digitalen Leitmedienwechsels

Die Website gmls.phsz.ch ist eine seit Dezember 2022 laufend erweiterte Sammlung von Einordnungen der Professur "Digitalisierung und Bildung" der Pädagogischen Hochschule Schwyz zur Frage, welche Auswirkungen generative Machine-Learning-Systeme wie ChatGPT auf die Schule haben.

Lizenz: Die Website steht unter einer CC-BY-ND-Lizenz, Bilder und Texte dürfen somit unter Quellenangabe an anderen Orten verwendet werden.

Zitationsvorschlag: Döbeli Honegger, Beat (2022-2026). ChatGPT & Co. und Schule. Einschätzungen der Professur "Digitalisierung und Bildung" der Pädagogischen Hochschule Schwyz. https://gmls.phsz.ch/ (abgerufen am 14 Apr 2026)

Alternativer Zitationsvorschlag: Insgesamt besteht gmls.phsz.ch aus ca. 50 einzelnen Seiten. Wesentliche Inhalte dieser Website sind auch in der folgenden, frei verfügbaren Publikation zu finden: Döbeli Honegger, Beat (2025). Generative Machine-Learning-Systeme - Die nächste Herausforderung des digitalen Leitmedienwechsels  In: Brägger, Gerold & Rolff, Hans-Günter: Handbuch Lernen mit digitalen Medien (3. Auflage). Beltz Verlag. https://zenodo.org/records/15042499

In: Brägger, Gerold & Rolff, Hans-Günter: Handbuch Lernen mit digitalen Medien (3. Auflage). Beltz Verlag. https://zenodo.org/records/15042499